Материалы по тегу: microsoft azure

|

20.11.2024 [10:56], Сергей Карасёв

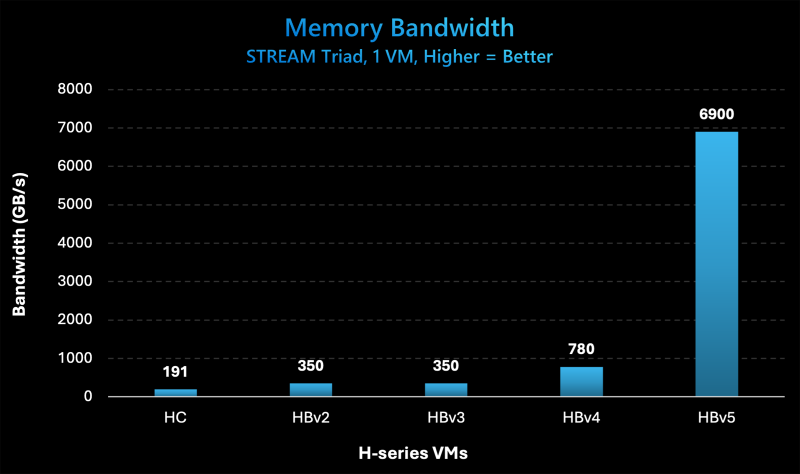

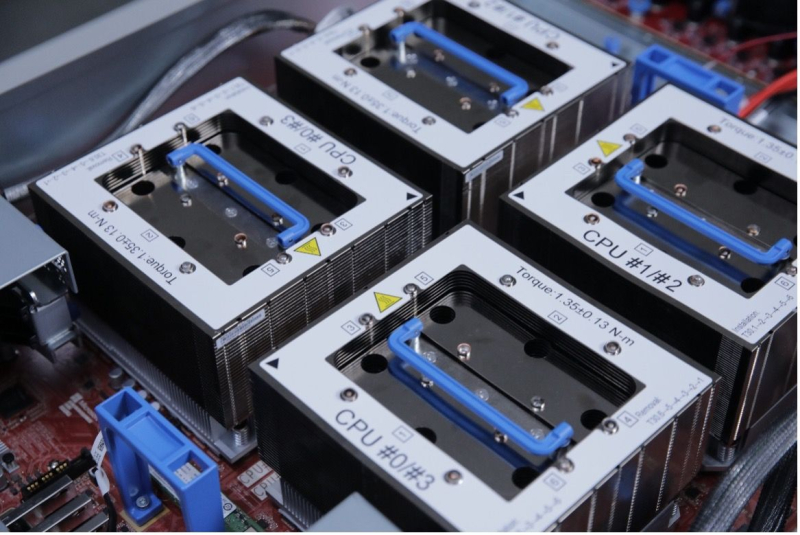

Microsoft представила инстансы Azure HBv5 на основе уникальных чипов AMD EPYC 9V64H с памятью HBM3Компания Microsoft на ежегодной конференции Ignite для разработчиков, IT-специалистов и партнёров анонсировала облачные инстансы Azure HBv5 для HPC-задач, которые предъявляют наиболее высокие требования к пропускной способности памяти. Новые виртуальные машины оптимизированы для таких приложений, как вычислительная гидродинамика, автомобильное и аэрокосмическое моделирование, прогнозирование погоды, исследования в области энергетики, автоматизированное проектирование и пр. Особенность Azure HBv5 заключается в использовании уникальных процессоров AMD EPYC 9V64H (поколения Genoa). Эти чипы насчитывают 88 вычислительных ядер Zen4, тактовая частота которых достигает 4 ГГц. Ближайшим родственником является изделие EPYC 9634, которое содержит 84 ядра (168 потоков) и функционирует на частоте до 3,7 ГГц. По данным ресурса ComputerBase.de, чип EPYC 9V64H также фигурирует под именем Instinct MI300C: по сути, это процессор EPYC, дополненный памятью HBM3. При этом клиентам предоставляется возможность кастомизации характеристик. Отметим, что ранее x86-процессоры с набортной памятью HBM2e были доступны в серии Intel Max (Xeon поколения Sapphire Rapids). Каждый инстанс Azure HBv5 объединяет четыре процессора EPYC 9V64H, что в сумме даёт 352 ядра. Система предоставляет доступ к 450 Гбайт памяти HBM3, пропускная способность которой достигает 6,9 Тбайт/с. Задействован интерконнект NVIDIA Quantum-2 InfiniBand со скоростью передачи данных до 200 Гбит/с в расчёте на CPU. Применены сетевые адаптеры Azure Boost NIC второго поколения, благодаря которым пропускная способность сети Azure Accelerated Networking находится на уровне 160 Гбит/с. Для локального хранилища на основе NVMe SSD заявлена скорость чтения информации до 50 Гбайт/с и скорость записи до 30 Гбайт/с. Отмечается, что по показателю пропускной способности памяти виртуальные машины Azure HBv5 примерно в 8 раз превосходят новейшие альтернативы bare-metal и cloud, в 20 раз опережают инстансы Azure HBv3 и Azure HBv2 (на базе EPYC Milan-X и EPYC Rome) и в 35 раз обходят HPC-серверы возрастом 4–5 лет, жизненный цикл которых приближается к завершению. Машины Azure HBv5 станут доступны в I половине 2025 года.

20.11.2024 [01:40], Владимир Мироненко

Microsoft представила кастомные чипы Azure Boost DPU и Integrated HSM, уникальный AMD EPYC 9V64H с HBM и собственный вариант NVIDIA GB200 NVL72

amd

azure arc

azure stack

dpu

epyc

gb200

hardware

hbm

hpc

microsoft

microsoft azure

nvidia

гибридное облако

ии

информационная безопасность

облако

ускоритель

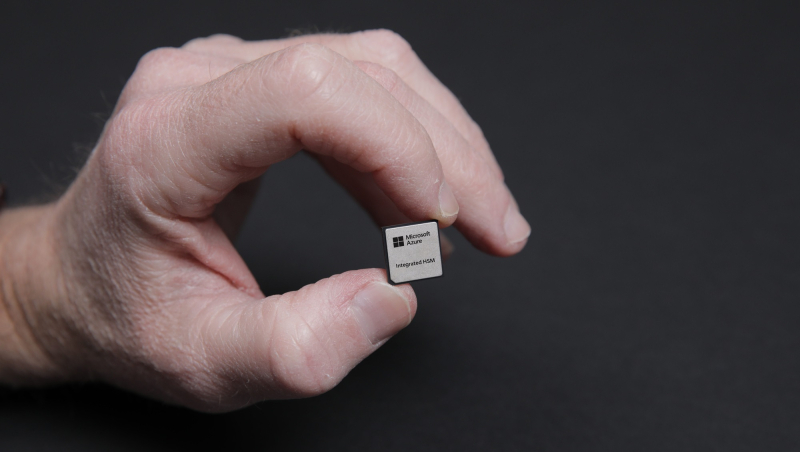

Microsoft представила на конференции Microsoft Ignite новые специализированные чипы Azure Boost DPU и Azure integrated Hardware Security Module (HSM), предназначенные для использования в ЦОД с целью поддержки рабочих нагрузок в облаке Azure и повышения безопасности.

Источник изображений: Microsoft Чтобы снизить зависимость от поставок чипов сторонних компаний, Microsoft занимается разработкой собственных решений для ЦОД. Например, на прошлогодней конференции Microsoft Ignite компания представила Arm-процессор Azure Cobalt 100 и ИИ-ускоритель Azure Maia 100 собственной разработки. Azure Boost DPU включает специализированные ускорители для работы с сетью и хранилищем, а также предлагает функции безопасности. Так, скорость работы с хранилищем у будущих инстансов Azure будет вчетверо выше, чем у нынешних, а энергоэффективность при этом вырастет втрое. Не вызывает сомнений, что в разработке Azure Boost DPU участвовали инженеры Fungible, производителя DPU, который Microsoft приобрела в декабре прошлого года. Как отмечает TechCrunch, в последние годы популярность DPU резко увеличилась. AWS разработала уже несколько поколений Nitro, Google совместно с Intel создала IPU, AMD предлагает DPU Pensando, а NVIDIA — BlueField. Есть и другие нишевые игроки. Согласно оценкам Allied Analytics, рынок чипов DPU может составить к 2031 году $5,5 млрд. Ещё один кастомный чип — Azure integrated Hardware Security Module (HSM) — отвечает за хранение цифровых криптографических подписей и ключей шифрования в защищённом модуле «без ущерба для производительности или увеличения задержки». «Azure Integrated HSM будет устанавливаться на каждом новом сервере в ЦОД Microsoft, начиная со следующего года, чтобы повысить защиту всего парка оборудования Azure как для конфиденциальных, так и для общих рабочих нагрузок», — заявила Microsoft. Azure Integrated HSM работает со всем стеком Azure, обеспечивая сквозную безопасность и защиту. Microsoft также объявила, что задействует ускорители NVIDIA Blackwell и кастомные серверные процессоры AMD EPYC. Так, инстансы Azure ND GB200 v6 будут использовать суперускорители NVIDIA GB200 NVL 72 в собственном исполнении Microsoft, а интерконнект Quantum InfiniBand позволит объединить десятки тысяч ускорителей Blackwell. Компания стремительно наращивает закупки этих систем. А инстансы Azure HBv5 получат уникальные 88-ядерные AMD EPYC 9V64H с памятью HBM, которые будут доступны только в облаке Azure. Каждый инстанс включает четыре таких CPU и до 450 Гбайт памяти с агрегированной пропускной способностью 6,9 Тбайт/с. Кроме того, Microsoft анонсировала новое решение Azure Local, которое заменит семейство Azure Stack. Azure Local — это облачная гибридная инфраструктурная платформа, поддерживаемая Azure Arc, которая объединяет локальные среды с «большим» облаком Azure. По словам компании, клиенты получат обновление до Azure Local в автоматическом режиме. Наконец, Microsoft анонсировала новые возможности в Azure AI Foundry, новой «унифицированной» платформе приложений ИИ, где организации смогут проектировать, настраивать и управлять своими приложениями и агентами ИИ. В числе новых опций — Azure AI Foundry SDK (пока в виде превью).

18.11.2024 [20:15], Руслан Авдеев

Ключевыми клиентами ИИ-сервиса Microsoft Azure OpenAI стали Adobe и Meta✴, но крупнейшим заказчиком всё ещё остаётся TikTokХотя крупнейшим облачным клиентом сервисов Azure OpenAI компании Microsoft по-прежнему остаётся социальная сеть TikTok, облачный ИИ-провайдер активно диверсифицирует свой бизнес. В распоряжение The Verge попал список крупнейших клиентов Microsoft, получающих облачный доступ к большим языковым моделям (LLM) — как оказалось, более $1 млн/мес. на сервисы Azure OpenAI тратит не только TikTok. В десятку ключевых пользователей Azure OpenAI вошли Adobe и Meta✴, каждая из которых потратила более $1 млн только в сентябре 2024 года. Впрочем, компании по-прежнему отстают от TikTok, принадлежащей ByteDance. Ранее сообщалось, что TikTok платила Microsoft почти $20 млн/мес. за доступ к моделям OpenAI. По итогам IV квартале 2024 финансового года, завершившемся 30 июня, на TikTok пришлось почти четверть выручки Azure OpenAI. Теперь траты ByteDance на Azure OpenAI составляют менее 15 % всей выручки Microsoft в этом сегменте — расходы ByteDance падают, а других клиентов растут. Например, G42 из ОАЭ тратит на сервисы Azure OpenAI миллионы долларов ежемесячно, являясь вторым по величине пользователем соответствующего сервиса после ByteDance. Ранее в этом году Microsoft инвестировала $1,5 млрд в G42, поэтому, вероятно, последняя сохранит статус одного из ключевых пользователей Azure OpenAI. Ранее в этом году главным потребителем ИИ-сервисов Microsoft считалась американская торговая сеть Walmart, но теперь её нет даже в десятке. Список серьёзно меняется от месяца к месяцу, во многом потому, что клиенты Microsoft время от времени запускают или тестируют новые ИИ-проекты. Так, постоянным клиентом остаётся Intuit, хотя её расходы несопоставимы с затратами G42 или ByteDance. Компания занимается разработкой инструментов для финансового управления и обучает собственные ИИ-модели на клиентских данных. Также Microsoft удалось привлечь к сотрудничеству тесно связанную с Alibaba компанию Ant Group, которая потратила на Azure OpenAI как минимум $1 млн. Среди ключевых клиентов есть и пекинская Sankuai Technology, а всего в десятку самых «дорогих» клиентов в сентябре вошли сразу три китайские компании. В Microsoft информацию не комментируют. В компании лишь отметили, что Azure OpenAI — один из самых быстрорастущих сервисов Azure за всю историю, которым уже пользуются 60 тыс. организаций по всему миру. За последние месяцы рост сервиса удвоился. Microsoft также продаёт лицензии Copilot для бизнеса, обеспечивающие ИИ-сервисы, например, в офисных приложениях. По данным самой компании, 70 % компаний из рейтинга Fortune 500 так или иначе пользуются Microsoft 365 Copilot. Скоро выручка ИИ-бизнеса Microsoft превысит $10 млрд в год. В Microsoft утверждают, что это будет самый быстрый в истории бизнес, достигший подобного показателя. Но пока затраты довольно велики, так что инвесторы внимательно наблюдают за показателями Azure OpenAI и Microsoft 365 Copilot. Microsoft уже не хватает ресурсов для обработки ИИ, но компания готова вкладывать деньги в новые ЦОД.

15.11.2024 [17:47], Владимир Мироненко

FTC собралась расследовать жалобы на антиконкурентную практику в облачном бизнесе MicrosoftФедеральная торговая комиссия США (FTC) готовится начать расследование заявлений по поводу использования Microsoft антиконкурентных практик в своём облачном бизнесе, сообщила Financial Times со ссылкой на информированные источники. По их словам, FTC пока не запросила документы или другую информацию у Microsoft. Это говорит о том, что расследование находится на ранней стадии и нет никаких гарантий, что оно будет продолжено. Как утверждают источники, сейчас FTC изучает обвинения Microsoft в злоупотреблении своей рыночной властью — компания якобы навязывает карательные условия лицензирования, чтобы помешать клиентам переносить свои данные из Azure на другие платформы. В частности, чтобы усложнить переход на другую платформу, Microsoft существенно увеличивает абонентскую плату для тех, кто покидает Azure, вводит высокие сборы за выход и якобы делает продукты Office 365 несовместимыми с облаками конкурентов. На этот шаг регулятора подтолкнуло письмо Google с обвинением Microsoft в антиконкурентной практике, направленное в комиссию в июне 2023 года. В письме утверждается, что Microsoft использует ограничения по лицензированию ПО, чтобы заставить клиентов использовать облачные сервисы Azure для экономии денег.  Google также заявила, что Microsoft использует доминирующее положение Windows Server и Office, чтобы оказывать давление на клиентов, заставляя их пользоваться Azure, и использует «сложную сеть» лицензионных ограничений, которые призваны помешать компаниям диверсифицировать поставщиков корпоративного ПО. Также было отмечено, что Microsoft взимает плату со сторонних поставщиков облачной инфраструктуры, таких как Google Cloud и Amazon Web Services, за запуск её ПО, такого как Windows Server и Office, на их платформах. В конечном итоге расходы перекладываются на клиентов. При этом дополнительная плата за запуск ПО Microsoft в облаке Azure не взимается. Аналитик Хольгер Мюллер (Holger Mueller) из Constellation Research сообщил в прошлом году, что поставщики ПО ужесточают условия лицензирования, чтобы ограничить своих конкурентов. «Основная уловка заключается в том, что они либо ограничивают сервисы, не позволяя им работать в других облаках, либо взимают большую плату за такую возможность», — сказал Мюллер. Microsoft удалось избежать официального расследования деятельности своего облачного подразделения со стороны Еврокомиссии с помощью сделки с CISPE. При этом Google пыталась с помощью денежного вознаграждения убедить облачные компании не прекращать жаловаться на Microsoft в ЕС. В итоге Google подала в Еврокомиссию новую жалобу на Microsoft и сформировала новую коалицию Open Cloud Coalition. Аналогичные разбирательства ведутся и в Великобритании.

09.11.2024 [15:17], Сергей Карасёв

До 96 ядер и 722 Гбайт RAM: в облаке Microsoft появились инстансы на собственных Arm-чипах Azure Cobalt 100Корпорация Microsoft объявила о том, что в облаке Azure стали общедоступными инстансы Dpsv6, Dplsv6 и Epsv6, в основу которых положены процессоры собственной разработки Azure Cobalt 100 на архитектуре Arm. Предварительные версии этих виртуальных машин были запущены весной нынешнего года. Чипы Azure Cobalt 100, представленные около года назад, содержат 128 ядер Armv9 Neoverse N2 (Perseus). По заявления Microsoft, эти изделия обеспечивают до 50 % более высокую производительность по сравнению с виртуальными машинами Azure на базе Arm-чипов других производителей. Инстансы серий Dpsv6 и Dpdsv6 предлагают до 96 vCPU (ядер) и 384 ГиБ (около 412 Гбайт) памяти (соотношение RAM к vCPU составляет 4:1). Они предназначены для масштабируемых рабочих нагрузок, небольших и средних баз данных, серверов приложений и веб-серверов. Инстансы Dplsv6 и Dpldsv6 насчитывают до 96 vCPU и оперируют максимум 192 ГиБ (около 206 Гбайт) памяти (соотношение RAM к vCPU равно 2:1). Такие инстансы подходят для кодирования мультимедийных материалов, небольших баз данных, игровых серверов, микросервисов и рабочих нагрузок, не требующих большого объема RAM. Наконец, решения Epsv6 и Epdsv6 предоставляют до 96 vCPU и до 672 ГиБ (около 722 Гбайт) памяти (соотношение RAM к vCPU — 8:1). Эти виртуальные машины предназначены для ресурсоёмких рабочих нагрузок, таких как большие базы данных и аналитика.  Для всех инстансов предусмотрено использование от двух до восьми сетевых адаптеров с пропускной способностью 12,5–60 Гбит/с. Варианты Dpdsv6, Dpldsv6 и Epdsv6 имеют локальное хранилище с производительностью от 15 тыс. до 1,8 млн IOPS. Виртуальные машины также поддерживают все типы удаленных хранилищ, включая Standard SSD, Standard HDD, Premium SSD и Ultra Disk. Новые инстансы доступны во многих регионах: Canada Central, Central US, East US 2, East US, Germany West Central, Japan East, Mexico Central, North Europe, Southeast Asia, Sweden Central, Switzerland North, UAE North, West Europe и West US 2. В дальнейшем добавятся регионы Australia East, Brazil South, France Central, India Central, South Central US, UK South, West US 3 и West US.

02.11.2024 [13:06], Владимир Мироненко

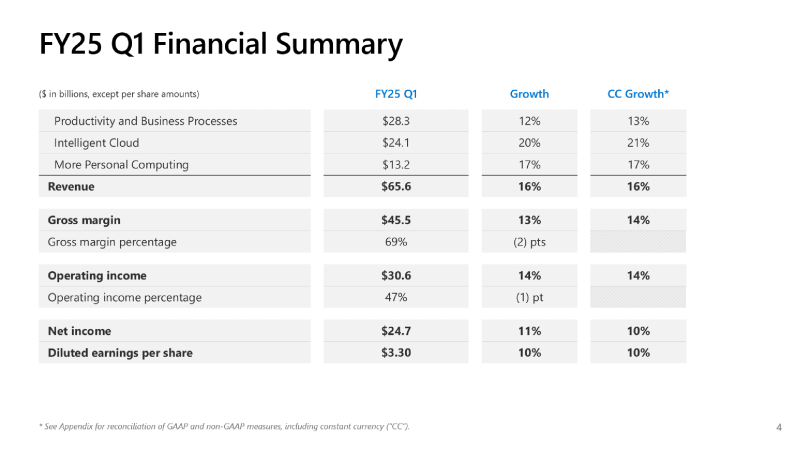

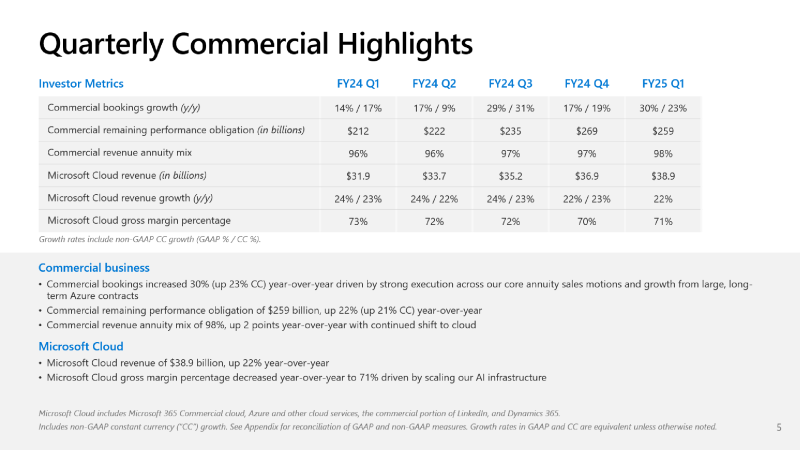

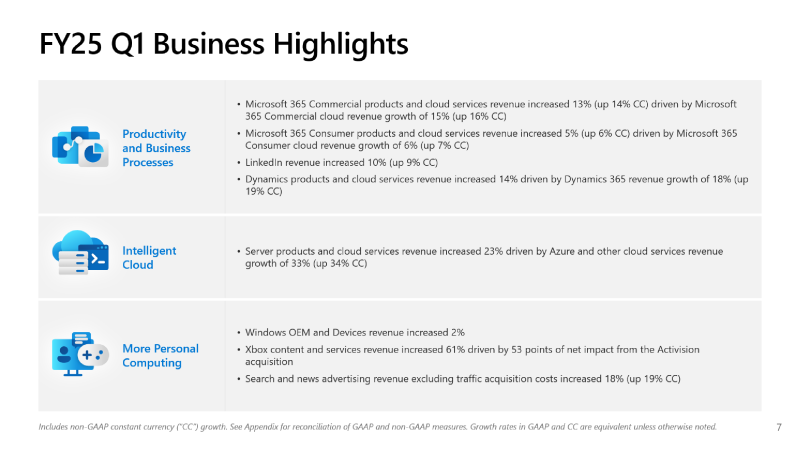

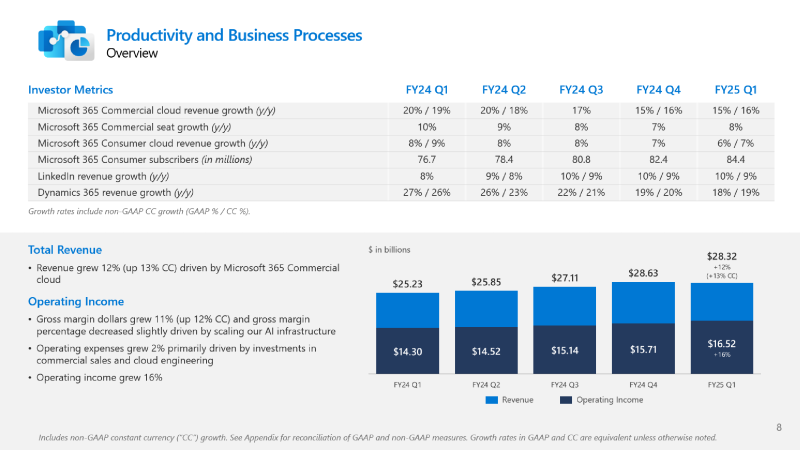

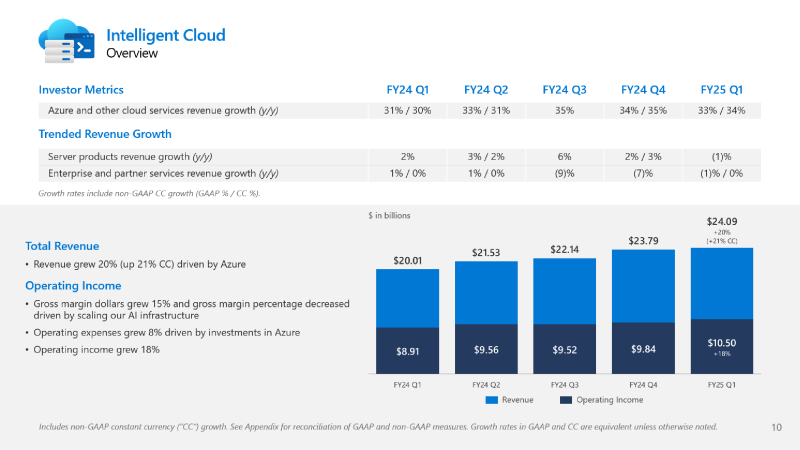

Microsoft не хватает ресурсов для обслуживания ИИ, но компания готова и далее вкладываться в ЦОД, хотя инвесторам это не по нравуMicrosoft сообщила о результатах работы в I квартале 2025 финансового года, завершившемся 30 сентября. Показатели компании превысили прогнозы аналитиков, но её ожидания и планы вызвали опасения инвесторов, так что акции упали в четверг на 6 %. До этого акции компании падали столь значительно 26 октября 2022 года — на 7,7 %, за месяц до публичного релиза ChatGPT, после которого начался бум на ИИ. В этот раз инвесторов не устроили планы компании по увеличению расходов на искусственный интеллект (ИИ) в текущем квартале и ожидаемое замедление роста облачного бизнеса Azure, что свидетельствует о том, что крупных инвестиций в ИИ было недостаточно, чтобы справиться с ограничениями мощности ЦОД компании — Microsoft попросту не хватает ресурсов для обслуживания заказчиков. Выручка Microsoft выросла год к году на 16 % до $65,6 млрд, что выше средней оценки аналитиков в $64,5 млрд, которых опросила LSEG. Чистая прибыль увеличилась на 11 % до $24,67 млрд, в то время как аналитики прогнозировали $23,15 млрд. Чистая прибыль на акцию составила $3,30 при прогнозе Уолл-стрит в рамзере $3,10. Сегмент Intelligent Cloud компании Microsoft, который охватывает облачные сервисы Azure, а также Windows Server, SQL Server, GitHub, Nuance, Visual Studio и корпоративные сервисы, показал рост выручки на 20 % в годовом исчислении до $24,1 млрд. Azure и другие облачные сервисы увеличили выручку на 33 %. При этом ИИ внес 12 п.п. в рост выручки Azure в отчётном квартале по сравнению с 11 п.п. в предыдущем трёхмесячном периоде. Большинство направлений бизнеса Microsoft показали значительный рост: LinkedIn — 10 %; продукты Dynamics и облачные сервисы — 14 %, в том числе Dynamics 365 — 18 %; серверные продукты и облачные сервисы — 23 %. Выручка Microsoft 365 Commercial Cloud выросла на 15 %, а потребительского Microsoft 365 и сопутствующих облачных сервисов — на 5 %. Вместе с тем внешние поставщики запаздывают с поставкой инфраструктуры ЦОД для Microsoft, что означает, что компания не сможет удовлетворить спрос во II финансовом квартале. Бретт Иверсен (Brett Iversen), вице-президент Microsoft по связям с инвесторами, подтвердил, что Microsoft не сможет решить проблему ограничений мощности ИИ до II половины финансового года. Microsoft прогнозирует замедление роста выручки Azure во II финансовом квартале до 31–32 %, что отстает от среднего роста в 32,25 %, ожидаемого аналитиками, согласно Visible Alpha. Наряду с замедлением роста выручки Azure у инвесторов вызывает обеспокоенность и то, что Microsoft вкладывает огромные средства в создание инфраструктуры ИИ и расширение ЦОД. Microsoft заявила, что за квартал капитальные затраты выросли на 5,3 % до $20 млрд по сравнению с $19 млрд в предыдущем квартале. Это выше оценки Visible Alpha в размере $19,23 млрд. Сообщается, что в основном средства пошли на расширение ЦОД. Всего за 2025 финансовый год, начавшийся в июле, по оценкам аналитиков Visible Alpha, компания потратит более $80 млрд, что на $30 млрд больше, чем в предыдущем финансовом году. Компания считается лидером среди крупных технологических компаний в гонке ИИ благодаря своему эксклюзивному партнёрству с OpenAI, разработчиком ИИ-чат-бота ChatGPT. Доход Microsoft от бизнеса ИИ пока невелик, хотя компания прогнозирует, что он станет более существенным. В текущем квартале компания планирует достичь выручки в размере $10 млрд в годовом исчислении. Также Microsoft сообщила об отказе от предоставления клиентам в аренду ускорителей для обучения новых моделей ИИ, сделав приоритетным инференс. «На самом деле мы не продаем другим просто GPU для обучения [ИИ-моделей], — сказал Сатья Наделла (Satya Nadella). — Это своего рода бизнес, от которого мы отказываемся, потому что у нас очень большой спрос на инференс» для поддержки различных Copilot и других услуг ИИ. Как сообщает The Register, финансовый директор Эми Худ (Amy Hood), в свою очередь заявила, что Microsoft рассматривает доход, полученный от инференса, как источник средств для оплаты будущих инициатив по обучению ИИ-моделей. Сейчас компания стремительно наращивает закупки суперускорителей NVIDIA GB200 NVL72, стремясь получить их до того, как они станут доступны другим игрокам. Кроме того, Azure станет посредником в процессе расширения ИИ-инфраструктуры OpenAI.

30.10.2024 [11:49], Сергей Карасёв

OpenAI разрабатывает собственные ИИ-чипы совместно с Broadcom и TSMC, а пока задействует AMD Instinct MI300XКомпания OpenAI, по информации Reuters, разрабатывает собственные чипы для обработки ИИ-задач. Партнёром в рамках данного проекта выступает Broadcom, а организовать производство изделий планируется на мощностях TSMC ориентировочно в 2026 году. Слухи о том, что OpenAI обсуждает с Broadcom возможность создания собственного ИИ-ускорителя, появились минувшим летом. Тогда говорилось, что эта инициатива является частью более масштабной программы OpenAI по увеличению вычислительных мощностей компании для разработки ИИ, преодолению дефицита ускорителей и снижению зависимости от NVIDIA. Как теперь стало известно, OpenAI уже несколько месяцев работает с Broadcom над своим первым чипом ИИ, ориентированным на задачи инференса. Соответствующая команда разработчиков насчитывает около 20 человек, включая специалистов, которые ранее принимали участие в проектировании ускорителей TPU в Google, в том числе Томаса Норри (Thomas Norrie) и Ричарда Хо (Richard Ho). Подробности о проекте не раскрываются. Reuters, ссылаясь на собственные источники, также сообщает, что OpenAI в дополнение к ИИ-ускорителям NVIDIA намерена взять на вооружение решения AMD, что позволит диверсифицировать поставки оборудования. Речь идёт о применении изделий Instinct MI300X, ресурсы которых будут использоваться через облачную платформу Microsoft Azure. Это позволит увеличить вычислительные мощности: компания OpenAI только в 2024 году намерена потратить на обучение ИИ-моделей и задачи инференса около $7 млрд. Вместе с тем, как отмечается, OpenAI пока отказалась от амбициозных планов по созданию собственного производства ИИ-чипов. Связано это с большими финансовыми и временными затратами, необходимыми для строительства предприятий.

29.10.2024 [13:39], Руслан Авдеев

Группа Open Cloud Coalition будет продвигать открытость на облачном рынке — Microsoft уже назвала её «искусственным газоном, созданным Google»На днях была основана новая группа Open Cloud Coalition (OCC), намеренная продвигать «открытость и совместимость» на рынке облачных услуг. По данным Computer Weekly, она будет поддерживать антимонопольные ведомства, надзирающие за бизнес-практиками гиперскейлеров. Новый проект пришёлся по вкусу не всем облачным операторам. OCC основана 10 компаниями, призывающими к большей открытости, совместимости и честной конкуренции на облачном рынке. Участники также обязуются публиковать исследовательские данные и консультировать регуляторов в Европе, исследующих антиконкурентное поведение. Примечательно, что в число основателей входит Google Cloud, недавно подавшая жалобу в Еврокомиссию на неконкурентные практики облачного лицензирования Microsoft. Не так давно ассоциация облачных провайдеров CISPE уже жаловалась европейским властям на Microsoft, но в итоге последняя урегулировала проблему, заплатив небольшим компаниям более $20 млн. Google, по слухам, предлагала в разы больше, чтобы более мелкие игроки не отказывались от претензий, но компанию и AWS оставили один на один с Microsoft, а последняя заявляла, что конкуренты «мутят воду», только притворяясь слабыми.

Источник изображения: jean wimmerlin/unsplash.com Теперь, по данным СМИ, Google фактически запускает собственную версию CISPE, включающую Centerprise International, Civo и Gigas, а также других мелких игроков, в том числе ControlPlane, DTP Group, Prolinx, Pulsant, Clairo и Room 101. Представители коалиции заявляют, что в будущем привлекут новых участников, а соответствующие переговоры уже ведутся. Новость о появлении коалиции обнародована на фоне вестей с мирового облачного рынка, где активно расследуется антиконкурентное поведение как Microsoft, так и Amazon (AWS). В частности, соответствующие расследования ведёт Управление по конкуренции и рынкам (CMA) Великобритании с подачи регулятора Ofcom, в сферу внимания которого попали Microsoft и AWS, не в последнюю очередь с подачи Google. Похожие расследования ведутся в Испании и Дании. В условиях, когда облачная инфраструктура становится незаменимой, многие компании попали в ловушки, связанные ограничительными соглашениями, фактически не дающими возможности реализовать «мультиоблачные» стратегии. Этот тренд и намерена изменить OCC, продвигая более конкурентные практики и открытые стандарты, а также принципы, позволяющие легко менять провайдеров. Впрочем, в Microsoft уже раскритиковали инициативу, назвав организацию «искусственным газоном, созданным Google». Хотя Google формально не является лидером коалиции, предполагается, что именно она является теневым «кукловодом». В Microsoft утверждают, что конкурент добивается двух целей — пытается отвлечь от антимонопольных расследований по всему миру, проводящихся против самой Google, и пытается изменить вектор внимания регуляторов в свою пользу вместо того, чтобы состязаться честно.

09.10.2024 [09:54], Сергей Карасёв

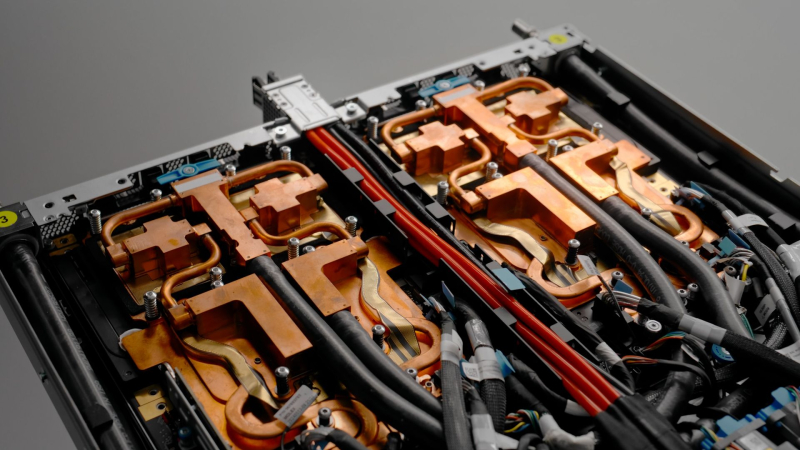

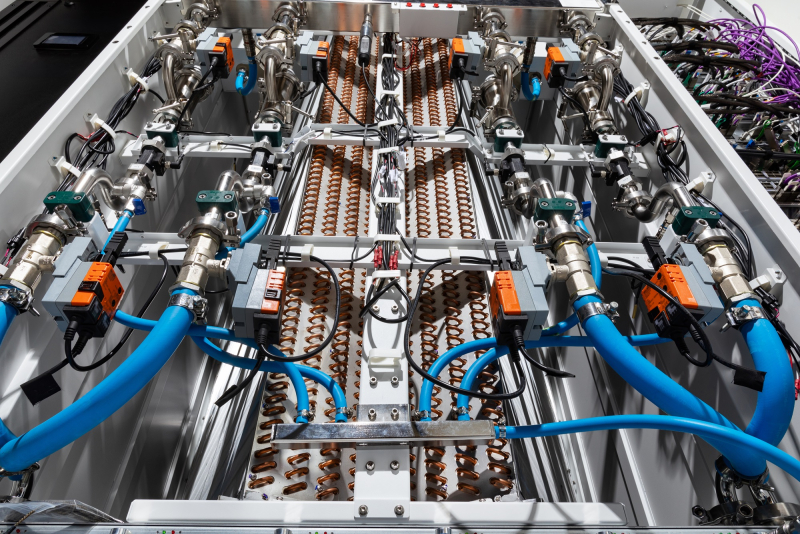

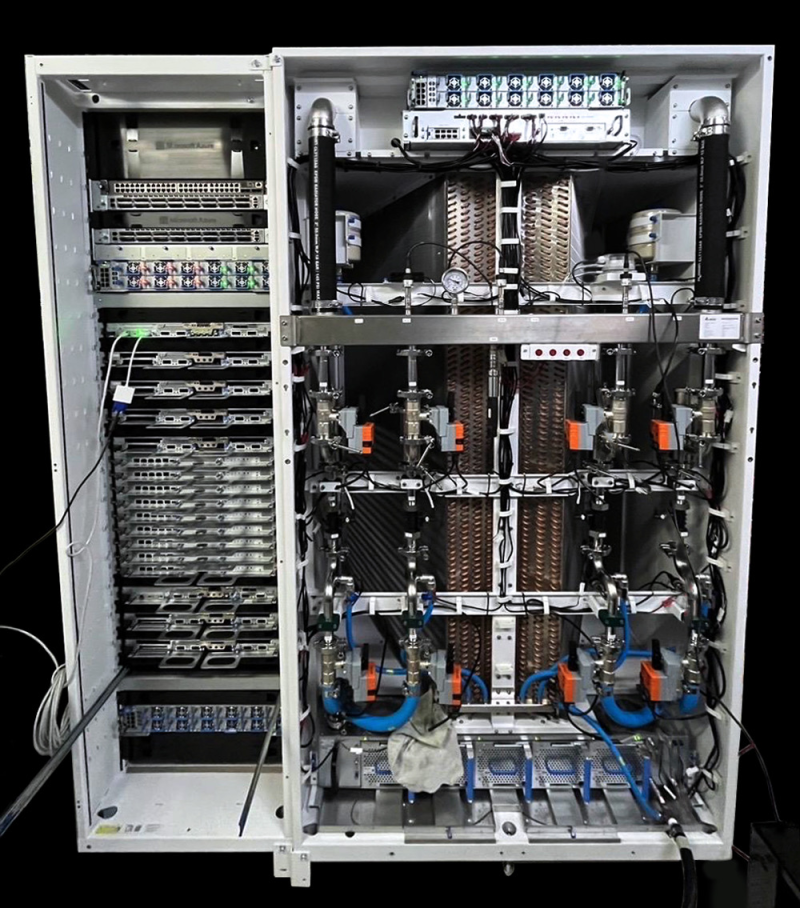

Фото дня: ИИ-система с NVIDIA GB200 и огромным радиатором для облака Microsoft AzureКорпорация Microsoft опубликовала в социальной сети Х фото новой ИИ-системы на базе ускорителей NVIDIA GB200 для облачной платформы Azure. Вычислительная стойка запечатлена рядом с блоком распределения охлаждающей жидкости (CDU), который является частью СЖО. Как отмечает ресурс ServeTheHome, вычислительная стойка содержит восемь узлов на основе GB200 с архитектурой Blackwell, а также ряд других компонентов. Точная конфигурация системы не раскрывается. На фотографии видно, что CDU-блок, расположенный по правую сторону от вычислительной стойки, имеет вдвое большую ширину. Он содержит крупноразмерный теплообменник жидкость — воздух, по сути, представляющий собой аналог автомобильного радиатора. Можно видеть насосы, элементы подсистемы питания, а также средства мониторинга. Наблюдатели отмечают, что обычно теплообменники шириной в две стойки предназначены для нескольких вычислительных стоек. Поэтому не исключено, что запечатленные на снимке изделия являются частью более крупной системы, где показанный CDU-блок будет отвечать за охлаждение сразу нескольких вычислительных стоек с ускорителями NVIDIA GB200. Напомним, ранее у Microsoft и NVIDIA возникли разногласия по поводу использования решений B200. NVIDIA настаивает на том, чтобы клиенты приобретали эти изделия в составе полноценных серверных стоек, тогда как Microsoft хочет использовать вариант стоек OCP с целью унификации инфраструктуры своих многочисленных дата-центров. Недавно также стало известно, что NVIDIA отказалась от выпуска двухстоечных суперускорителей GB200 NVL36×2 в пользу одностоечных вариантов NVL72 и NVL36. Причём Microsoft отдала предпочтение именно NVL72: корпорация начнёт получать эти системы в декабре.

07.10.2024 [12:19], Сергей Карасёв

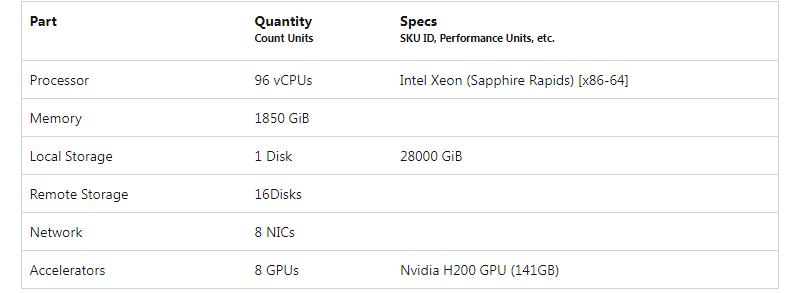

В облаке Microsoft Azure появились инстансы ND H200 v5 на базе NVIDIA H200В августе 2023 года Microsoft развернула в своём облаке Azure инстансы ND H100 v5 на базе NVIDIA H100 для HPC-вычислений и нагрузок ИИ. А теперь запущены машины ND H200 v5 с ускорителями NVIDIA H200, оптимизированные для инференса и обучения больших языковых моделей (LLM). Новые инстансы объединяют восемь ускорителей NVIDIA H200, каждый из которых содержит 141 Гбайт памяти HBM3e с пропускной способностью 4,8 Тбайт/с. По сравнению с NVIDIA H100 объём памяти увеличился на 76 %, пропускная способность — на 43 %. Для ND H200 v5 предусмотрена возможность масштабирования до тысяч ускорителей при помощи интерконнекта на базе NVIDIA Quantum-2 CX7 InfiniBand с пропускной способностью до 400 Гбит/с в расчёте на ускоритель (до 3,2 Тбит/с на виртуальную машину). В составе инстансов задействованы чипы Intel Xeon поколения Sapphire Rapids: каждая виртуальная машина насчитывает 96 vCPU. Объём памяти составляет 1850 Гбайт, вместимость локального хранилища — 28 000 Гбайт. Обеспечивается доступ к 16 облачным накопителям. Кроме того, используются восемь сетевых адаптеров (суммарно до 80 Гбит/c).

Источник изображения: Microsoft Виртуальные машины ND H200 v5 имеют предварительную интеграцию с Azure Batch, Azure Kubernetes Service, Azure OpenAI Service и Azure Machine Learning. Говорится, что инстансы обеспечивают высокую производительность при решении различных задач, связанных с ИИ, машинным обучением и аналитикой данных. |

|